AI-spraakgeneratie: de complete gids voor tekst-naar-spraaktechnologie

AI-spraakgeneratie: de complete gids voor tekst-naar-spraak-technologie

Ontdek de technologie, voordelen en beste praktijken op het gebied van AI-stemgeneratie. Ontdek hoe AI-tekst-naar-spraak realistische stemmen creëert voor video’s, podcasts en andere content.

AI-stemgeneratie

Belangrijkste conclusie | Toelichting |

|---|---|

De geluidskwaliteit van AI-stemmen in 2026 | Moderne tekst-naar-spraaktechnologie produceert spraak van bijna menselijke kwaliteit, met een natuurlijke intonatie en emotionele expressie |

Taalondersteuning | Toonaangevende platforms ondersteunen meer dan 100 talen, inclusief regionale accenten en culturele nuances |

Mogelijkheden voor het klonen van stemmen | Geavanceerde systemen kunnen specifieke stemmen nabootsen op basis van korte geluidsfragmenten, voor gepersonaliseerde inhoud |

Realtime verwerking | Met de huidige technologie is het mogelijk om direct spraak te genereren voor live-toepassingen en interactieve content |

Commerciële toepassingen | Bedrijven gebruiken AI-stemmen voor marketingvideo’s, e-learning, toegankelijkheid en meertalige content |

Kostenefficiëntie | Geautomatiseerde spraaksynthese verlaagt de productiekosten met 80 tot 90% in vergelijking met traditionele stemacteurs |

Inhoudsopgave

Wat is AI-stemgeneratie?

Hoe AI-stemgeneratie werkt

Belangrijkste voordelen van AI-stemgeneratie

Veelvoorkomende uitdagingen en fouten

Beste praktijken voor AI-stemgeneratie in 2026

Bronnen en referenties

Veelgestelde vragen

AI-stemgeneratie zorgt voor een revolutie in de manier waarop bedrijven audiocontent creëren, door tekst direct om te zetten in natuurlijk klinkende spraak in meerdere talen. Deze technologie zet geschreven content om in levensechte voice-overs zonder dat er menselijke stemacteurs nodig zijn, waardoor professionele audioproductie toegankelijk wordt voor organisaties van elke omvang. In 2026 heeft deze innovatieve tekst-naar-spraaktechnologie een ongekend niveau van realisme en functionaliteit bereikt. De impact van de technologie reikt veel verder dan alleen het omzetten van tekst naar spraak. Moderne AI-spraaksystemen kunnen specifieke stemkenmerken nabootsen, een consistente emotionele toon behouden en zelfs synchroniseren met videocontent voor een naadloze multimedia-ervaring. Voor bedrijven die wereldwijd uitbreiden, biedt geautomatiseerde spraaksynthese de mogelijkheid om snel gelokaliseerde content te creëren met behoud van de merkstem in verschillende markten.

Wat is AI-stemgeneratie?

AI-spraakgeneratie is een technologie op basis van machine learning die geschreven tekst omzet in gesproken audio met behulp van kunstmatige neurale netwerken die zijn getraind op basis van enorme datasets met menselijke spraakpatronen. Dit proces, ook wel bekend als tekst-naar-spraak (TTS)-synthese, produceert realistische spraak die de intonatie, het ritme en de uitspraak van mensen nabootst in verschillende talen en met verschillende accenten.

Kerntechnologische componenten

De basis van tekst-naar-spraaktechnologie wordt gevormd door verschillende onderling verbonden technologieën die samenwerken om natuurlijk klinkende spraak te produceren. Deep learning-modellen analyseren taalkundige patronen, fonetische structuren en akoestische eigenschappen om te begrijpen hoe mensen van nature spreken. Deze systemen verwerken tekst via meerdere analyselagen, van eenvoudige woordherkenning tot complexe emotionele interpretatie. Moderne AI-spraakplatforms maken gebruik van transformer-architecturen en generatieve adversariale netwerken (GAN's) om een menselijke kwaliteit te bereiken. Volgens onderzoek van ElevenLabs kunnen toonaangevende spraakgeneratiesystemen nu spraak produceren die in gecontroleerde luistertests vrijwel niet te onderscheiden is van menselijke opnames [1]. De technologie is geëvolueerd van vroegere systemen die robotachtig klonken tot geavanceerde platforms die in staat zijn tot emotionele expressie en persoonlijkheidskenmerken.

Ontwikkeling en huidige mogelijkheden

De ontwikkeling van eenvoudige computergestuurde spraak naar de geavanceerde spraaksynthese van vandaag is het resultaat van tientallen jaren technologische vooruitgang. Vroege tekst-naar-spraak-systemen maakten gebruik van concatenaatieve synthese, waarbij vooraf opgenomen fonemen aan elkaar werden gekoppeld om woorden te vormen. Deze aanpak leverde een schokkerige, onnatuurlijk klinkende output op die duidelijk te herkennen was als door een machine gegenereerd. Huidige AI-spraaksystemen maken gebruik van neurale netwerken die zijn getraind op miljoenen uren aan menselijke spraakgegevens. Deze modellen begrijpen context, emotie en subtiele taalkundige nuances die spraak natuurlijk laten klinken. Vanaf 2026 bieden platforms zoals Speechify en LOVO spraakbibliotheken aan met honderden verschillende stemmen in meer dan 60 talen [2]. De technologie ondersteunt nu realtime generatie, het klonen van stemmen op basis van minimale samples en adaptieve toonaanpassing voor verschillende soorten inhoud.

Pro-tip: Probeer AI-spraakplatforms uit met je eigen inhoud in plaats van met demoscripts. Teksten uit de praktijk bevatten vaak vakjargon, eigennamen en complexe zinnen die de kwaliteitsverschillen tussen systemen aan het licht brengen.

Hoe AI-stemgeneratie werkt

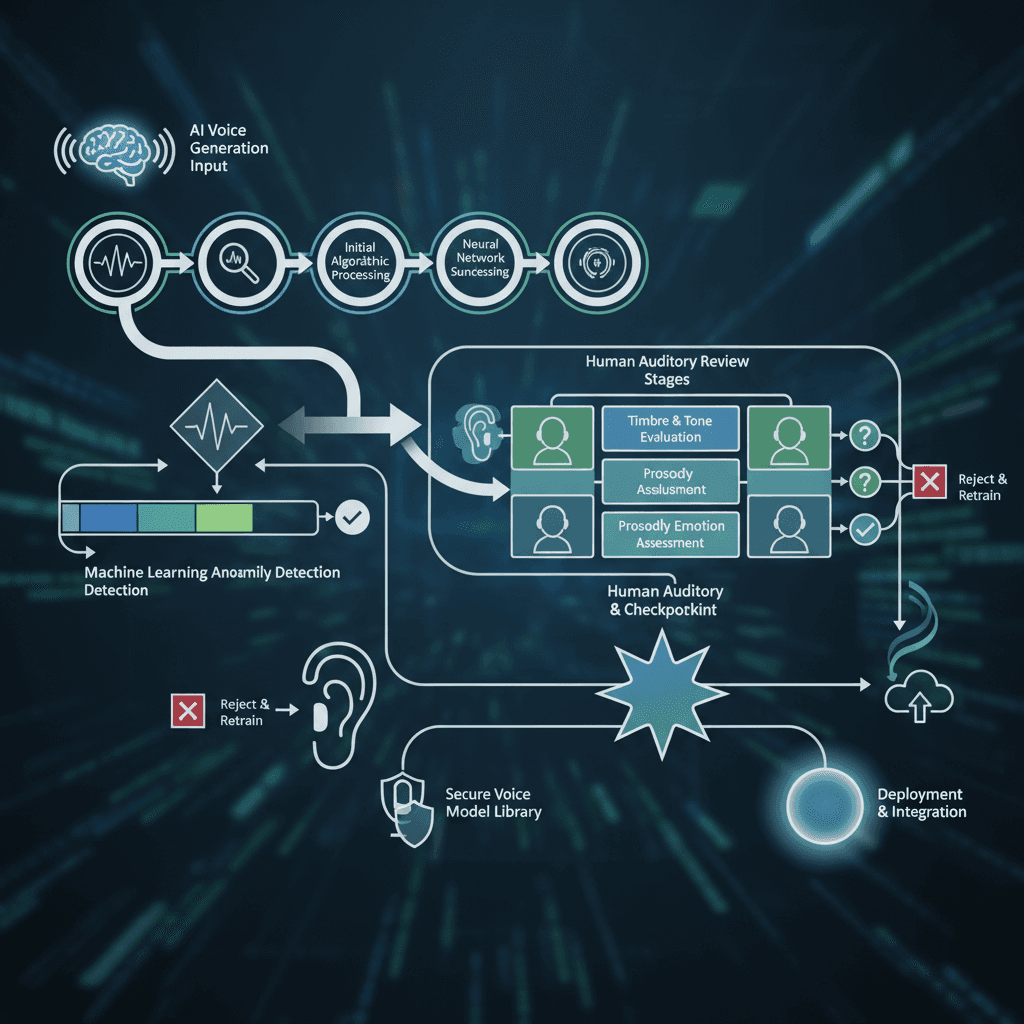

Geautomatiseerde spraaksynthese werkt via een geavanceerd proces in meerdere fasen, waarbij tekstinvoer wordt omgezet in natuurlijk klinkende audio-uitvoer met behulp van geavanceerde algoritmen voor machine learning en neurale netwerkarchitecturen.

Tekstverwerking en -analyse

Het proces van stemgeneratie begint met een uitgebreide tekstanalyse, waarbij AI-systemen de ingevoerde inhoud ontleden om de taalkundige structuur, de context en de bedoelde betekenis te begrijpen. Algoritmen voor natuurlijke taalverwerking (NLP) identificeren zinsgrenzen, interpunctie en grammaticale relaties die van invloed zijn op spraakpatronen. Het systeem analyseert elk woord op uitspraakregels, klemtoonpatronen en fonetische weergaven. Geavanceerde platforms voeren een semantische analyse uit om de context en emotionele ondertonen in de tekst te begrijpen. Deze analyse helpt bij het bepalen van de juiste vocale nadruk, het tempo en de intonatiepatronen. Een vraagteken zorgt bijvoorbeeld voor een stijgende intonatie, terwijl uitroeptekens duiden op meer energie en volume. Het systeem identificeert ook eigennamen, acroniemen en gespecialiseerde terminologie die een specifieke uitspraak vereisen.

Verwerking via neurale netwerken

Zodra de tekstanalyse is voltooid, verwerken neurale netwerken de taalkundige gegevens via meerdere transformatielagen om een audio-uitvoer te genereren. De kern van de verwerking bestaat uit verschillende gespecialiseerde netwerkcomponenten die achtereenvolgens worden uitgevoerd:

Encodernetwerken zetten teksttokens om in compacte vectorrepresentaties die semantische en fonetische informatie bevatten

Aandachtsmechanismen brengen verbanden aan het licht tussen woorden en woordgroepen die van invloed zijn op de uitspraak en de klemtoon

Decodernetwerken zetten verwerkte vectoren om in mel-spectrogramweergaven van audiofrequenties

Vocodernetwerken zetten spectrogrammen om in uiteindelijke audiogolfvormen die mensen kunnen horen

Moderne systemen, zoals die van Typecast en Canva, maken gebruik van transformer-architecturen die hele zinnen tegelijkertijd verwerken in plaats van woord voor woord [3][4]. Deze parallelle verwerking zorgt voor een beter begrip van de context en een natuurlijkere spraakstroom. De neurale netwerken zijn getraind op diverse spraakdatasets die verschillende accenten, spreekstijlen en emotionele uitingen weergeven.

Pro-tip: Kies voor meertalige content platforms die voor elke taal aparte modellen trainen, in plaats van universele modellen te gebruiken. Taalspecifieke training zorgt voor een nauwkeurigere uitspraak en natuurlijker klinkende resultaten.

Het hele proces, van tekstinvoer tot audio-uitvoer, is doorgaans binnen enkele seconden voltooid, waardoor realtime toepassingen en interactieve spraakervaringen mogelijk worden. Kwaliteitsplatforms zorgen voor consistentie bij teksten van verschillende lengtes en passen zich tegelijkertijd aan verschillende soorten inhoud en spreekcontexten aan.

Belangrijkste voordelen van AI-stemgeneratie

Tekst-naar-spraaktechnologie biedt aanzienlijke voordelen voor bedrijven die op zoek zijn naar een efficiënte, schaalbare manier om audiocontent te produceren, met behoud van professionele kwaliteit en wereldwijd bereik.

Kostenefficiëntie en schaalbaarheid

Bij traditionele spraakproductie moet men professionele stemacteurs inhuren, studiotijd reserveren en complexe opnameschema’s beheren. Geautomatiseerde spraaksynthese maakt een einde aan deze overheadkosten en biedt tegelijkertijd onbeperkte mogelijkheden voor het creëren van content. Bedrijven kunnen uren aan voice-overcontent produceren voor de prijs van één enkele professionele opnamesessie. De voordelen van schaalbaarheid worden vooral duidelijk voor organisaties die meertalige content maken. In plaats van voor elke doeltaal een stemacteur in te huren, kunnen bedrijven consistente audio genereren in meer dan 100 talen met behulp van platforms zoals LOVO of FreeTTS [5][6]. Deze aanpak verkort de productietijd van weken tot uren, terwijl de kwaliteitsnormen voor alle taalversies gehandhaafd blijven. Uit kostenanalyses in brancheverslagen blijkt dat geautomatiseerde spraaksynthese de kosten voor audioproductie met 80-90% verlaagt in vergelijking met traditionele methoden. Voor e-learningbedrijven, marketingbureaus en contentmakers maakt deze kostenbesparing frequentere contentupdates en een bredere taaldekking mogelijk zonder budgetbeperkingen.

Snelheid en consistentie

Tekst-naar-spraaktechnologie levert onmiddellijke resultaten op, waardoor snelle aanpassingen aan content en realtime audioproductie mogelijk worden. Contentmakers kunnen direct voice-overs genereren, verschillende stemstijlen uitproberen en direct wijzigingen aanbrengen zonder vertragingen in de planning of extra kosten. Dit snelheidsvoordeel blijkt cruciaal te zijn voor tijdgevoelige marketingcampagnes, nieuwsberichten en dynamisch educatief materiaal. Consistentie is een ander belangrijk voordeel, aangezien AI-stemmen bij onbeperkte hoeveelheden content altijd dezelfde kwaliteit, toon en uitspraak behouden. De prestaties van menselijke stemacteurs variëren van nature tussen opnamesessies als gevolg van gezondheid, stemming en omgevingsfactoren. AI-systemen leveren perfect consistente output, waardoor de uniformiteit van de merkstem in alle audiocontent wordt gewaarborgd.

Productiemethode | Duur | Kosten per uur | Flexibiliteit bij herzieningen |

|---|---|---|---|

Professioneel stemacteur | 3-5 dagen | $500–2000 | Beperkt/Duur |

AI-stemgeneratie | Notulen | $10–50 | Onbeperkt/Direct |

Geautomatiseerde TTS (basis) | Notulen | $5-20 | Hoog/Direct |

Bij Trame hebben we gemerkt dat geautomatiseerde spraaksynthese vooral voordelen biedt bij videolokalisatieprojecten, waarbij een nauwkeurige beheersing van de audioduur nodig is om de lipsynchronisatie in meerdere talen te waarborgen. Traditionele stemacteurs hebben vaak moeite om precies aan de timingvereisten te voldoen, terwijl AI-systemen perfect getimede audio kunnen genereren die naadloos aansluit op de visuele inhoud.

Toegankelijkheid en wereldwijd bereik

Tekst-naar-spraaktechnologie verbetert de toegankelijkheid van content aanzienlijk voor mensen met een visuele beperking, leesproblemen of een leerstoornis. Organisaties kunnen geschreven content direct omzetten naar audioformaat, waardoor informatie toegankelijk wordt voor een breder publiek zonder dat dit extra ontwikkelingstijd of middelen vergt. Dankzij de meertalige mogelijkheden van deze technologie kunnen bedrijven wereldwijde markten efficiënt bereiken. Bedrijven kunnen gelokaliseerde audiocontent creëren voor een internationaal publiek, terwijl de merkboodschap consistent blijft. Opties voor regionale accenten en aanpassingen aan de culturele uitspraak zorgen ervoor dat de content op authentieke wijze aanslaat bij lokale markten.

Veelvoorkomende uitdagingen en fouten

Ondanks aanzienlijke technologische vooruitgang kent geautomatiseerde spraaksynthese nog steeds een aantal uitdagingen en veelvoorkomende implementatiefouten die organisaties moeten begrijpen en aanpakken om een succesvolle implementatie te garanderen.

Kwaliteits- en authenticiteitskwesties

Een van de hardnekkigste uitdagingen is het realiseren van een consistent natuurlijk klinkende uitvoer voor verschillende soorten inhoud en talen. Hoewel de tekst-naar-spraaktechnologie enorm is verbeterd, vertonen bepaalde tekstpatronen nog steeds kunstmatige kenmerken. Technisch jargon, eigennamen en complexe zinsstructuren kunnen leiden tot een onnatuurlijke uitspraak of een onnatuurlijk spreekritme. Veelvoorkomende kwaliteitsproblemen zijn onder meer:

Onregelmatige klemtoon op belangrijke woorden of zinsdelen in langere passages

Moeite met het correct gebruiken van afkortingen, acroniemen en vakspecifieke terminologie

Onnatuurlijke ademhalingspatronen of pauzes die niet aansluiten bij het ritme van de menselijke spraak

Emotionele discrepanties waarbij de toon van de stem niet overeenkomt met de beoogde sfeer van de inhoud

Fouten in de uitspraak van namen, plaatsnamen en cultuurspecifieke termen

Een veelgemaakte fout van organisaties is dat ze ervan uitgaan dat alle AI-spraakplatforms dezelfde kwaliteit bieden. Er bestaan echter aanzienlijke verschillen tussen aanbieders wat betreft natuurlijkheid, taalondersteuning en gespecialiseerde functies. Door te testen met echte inhoud in plaats van demoscripts komen deze kwaliteitsverschillen aan het licht, die van invloed zijn op de gebruikerservaring.

Implementatie en technische uitdagingen

De technische implementatie brengt vaak onverwachte complicaties met zich mee die spraaksyntheseprojecten kunnen doen mislukken. Er doen zich integratieproblemen voor bij het koppelen van API’s voor spraakgeneratie aan bestaande contentmanagementsystemen, videobewerkingsworkflows of e-learningplatforms. Veel organisaties onderschatten de technische complexiteit die gepaard gaat met een naadloze integratie. Verwerkingsbeperkingen vormen een andere belangrijke uitdaging, met name voor organisaties die grote hoeveelheden content nodig hebben. Zelfs geavanceerde platforms zoals QuillBot en NoteGPT kennen gebruikslimieten en verwerkingsvertragingen tijdens piekperiodes [7][8]. Realtime-toepassingen vereisen een zorgvuldige architectuurplanning om vertragingen op te vangen en consistente prestaties te garanderen. Beperkingen op het gebied van tekens en talen kunnen de flexibiliteit van de content beperken. De meeste platforms hanteren een maximum aantal tekens per generatieverzoek, waardoor langere teksten moeten worden opgedeeld. Sommige systemen hebben moeite met content in meerdere talen of met specifieke opmaakvereisten die vaak voorkomen in technische documentatie of educatief materiaal.

Pro-tip: Test geautomatiseerde spraaksynthese altijd met de meest veeleisende inhoud – technische handleidingen, juridische documenten of teksten waarin veel afkortingen worden gebruikt. Deze stresstests brengen de beperkingen van het platform aan het licht voordat het volledig wordt geïmplementeerd.

Ethische en juridische overwegingen

Mogelijkheden voor het klonen van stemmen roepen belangrijke ethische vragen op over toestemming en het risico op misbruik. Hoewel de technologie legitieme toepassingen mogelijk maakt, zoals het bewaren van stemmen voor medische patiënten of het creëren van een consistente merkstem, biedt ze ook mogelijkheden voor misleiding en fraude. Organisaties moeten een duidelijk beleid opstellen voor het gebruik van stemklonen en de juiste toestemming verkrijgen. Kwesties rond auteursrecht en licenties maken het commerciële gebruik van AI-stemmen ingewikkeld. Sommige platforms beperken commercieel gebruik of vereisen aanvullende licenties voor zakelijke toepassingen. Inzicht in deze beperkingen voorkomt juridische complicaties en zorgt ervoor dat de servicevoorwaarden van het platform worden nageleefd. Bij het gebruik van cloudgebaseerde diensten voor het genereren van stemmen ontstaan zorgen over gegevensprivacy. Geüploade tekstinhoud kan door dienstverleners worden opgeslagen of geanalyseerd, waardoor gevoelige bedrijfsinformatie mogelijk wordt blootgesteld. Organisaties die met vertrouwelijke inhoud werken, moeten het privacybeleid evalueren en waar nodig oplossingen op locatie overwegen.

Beste praktijken voor AI-stemgeneratie in 2026

Om tekst-naar-spraaktechnologie succesvol te implementeren, zijn strategische planning, een zorgvuldige platformkeuze en voortdurende optimalisatie nodig om professionele resultaten te behalen die aansluiten bij de bedrijfsdoelstellingen.

Platformkeuze en -optimalisatie

De keuze voor het juiste platform voor spraaksynthese hangt af van specifieke gebruikssituaties, kwaliteitseisen en integratiebehoeften. Toonaangevende platforms in 2026 bieden duidelijke voordelen voor verschillende toepassingen. ElevenLabs blinkt uit in het klonen van stemmen en het weergeven van emoties, terwijl Speechify zich richt op toegankelijkheid en voorleestoepassingen [1][2]. Belangrijke beoordelingscriteria bij de keuze van een platform zijn onder meer:

Gesprekskwaliteit en natuurlijkheid in al uw doeltalen

Betrouwbaarheid en verwerkingssnelheid van de API voor uw verwerkingsvolumes

Integratiemogelijkheden met bestaande workflows en systemen

Afstemming van de tariefstructuur op de verwachte gebruikspatronen

Beschikbare stemstijlen en aanpassingsmogelijkheden

Rechten voor commercieel gebruik en licentievoorwaarden

Het testen van meerdere platforms met echte inhoud levert de meest nauwkeurige kwaliteitsvergelijking op. Stel evaluatiescripts op met behulp van echte zakelijke inhoud, inclusief uitdagende elementen zoals technische termen, eigennamen en gevarieerde zinsstructuren. Deze testaanpak brengt praktische verschillen aan het licht die bij demomateriaal wellicht niet naar voren komen.

Strategieën voor inhoudsoptimalisatie

Het optimaliseren van inhoud voor automatische spraaksynthese leidt tot een aanzienlijke verbetering van de uitvoerkwaliteit en de natuurlijkheid. Goed gestructureerde tekst levert betere resultaten op dan inhoud die uitsluitend voor het lezen is geschreven. Houd bij het opstellen van inhoud rekening met de manier waarop deze wordt voorgelezen, door natuurlijke pauzes, een duidelijke zinsopbouw en passende emotionele accenten in te bouwen. Effectieve technieken voor inhoudsoptimalisatie zijn onder meer:

Kortere zinnen schrijven met een duidelijke onderwerp-werkwoord-lijdend voorwerp-structuur

Met fonetische spellingen voor ongebruikelijke eigennamen of technische termen

Leestekens toevoegen om het gewenste tempo en de nadruk aan te geven

Vermijd overmatig gebruik van afkortingen en acroniemen die de uitspraak kunnen bemoeilijken

Inhoud structureren met een natuurlijk spreekritme en een logische opbouw

Bij Trame hebben we richtlijnen voor inhoud opgesteld die specifiek zijn afgestemd op meertalige spraaksynthese en die zorgen voor een consistente kwaliteit in alle talen. Deze richtlijnen hebben betrekking op culturele voorkeuren op het gebied van uitspraak, de keuze van regionale accenten en timingaspecten voor videosynchronisatie.

Pro-tip: Stel een uitspraakwoordenboek samen met veelgebruikte merknamen, producttermen en vakjargon. De meeste geavanceerde platforms bieden de mogelijkheid om aangepaste uitspraakregels in te stellen, waardoor de consistentie in alle content wordt verbeterd.

Kwaliteitsborging en workflow-integratie

Het opzetten van robuuste kwaliteitsborgingsprocessen zorgt voor consistente AI-spraakuitvoer die voldoet aan professionele normen. Ontwikkel beoordelingsworkflows die zowel geautomatiseerde kwaliteitscontroles als menselijke validatie voor cruciale inhoud omvatten. Geautomatiseerde tools kunnen technische problemen zoals audioartefacten of timingproblemen opsporen, terwijl menselijke beoordelaars de natuurlijkheid en geschiktheid evalueren. Effectieve kwaliteitsborgingsworkflows omvatten meerdere validatiefasen. Een eerste geautomatiseerde screening spoort duidelijke technische problemen op, gevolgd door een inhoudelijke beoordeling op nauwkeurigheid en geschiktheid van de toon. Een laatste menselijke validatie zorgt ervoor dat de gegenereerde stem aansluit bij de merkstandaarden en de verwachtingen van het publiek. Bij de integratieplanning moet rekening worden gehouden met zowel technische als operationele overwegingen. Technische integratie omvat API-connectiviteit, compatibiliteit van bestandsformaten en workflowautomatisering. Operationele integratie omvat teamtraining, goedkeuringsprocessen voor inhoud en documentatie van kwaliteitsnormen.

Bronnen en referenties

ElevenLabs, "Gratis platform voor AI-stemmengeneratoren en spraakagenten", 2026

Speechify, "Gratis AI-stemgenerator! AI-stemmen, geen registratie nodig", 2026

Typecast, "AI-stemmengenerator & tekst-naar-spraak | Voice-over-tool", 2026

Canva, "AI-stemmengenerator: tekst-naar-spraak online", 2026

LOVO, "Gratis AI-stemmengenerator & tekst-naar-spraak", 2026

FreeTTS, "Gratis tekst-naar-spraak online – AI-stemmengenerator", 2026

QuillBot, "Gratis AI-stemgenerator | Maak online realistische AI-voice-overs", 2026

NoteGPT, "Gratis AI-stemmengenerator – Maak online stemmen, geen aanmelding nodig", 2026

ResponsiveVoice, "ResponsiveVoice Tekst-naar-spraak – ResponsiveVoice.JS AI Tekst-naar-spraak", 2026

NiceVoice, "NiceVoice – Gratis tool voor het klonen van stemmen met AI", 2026

Veelgestelde vragen

1. Hoe realistisch klinkt AI-stemgeneratie in 2026?

Inzicht in AI-spraakgeneratie is van essentieel belang. Moderne tekst-naar-spraaktechnologie levert uiterst realistische resultaten op die onder gecontroleerde omstandigheden vaak niet van menselijke spraak te onderscheiden zijn. Toonaangevende platforms behalen in professionele evaluaties een natuurlijkheidsscore van meer dan 95%, waarbij de emotionele expressie en het contextbegrip voortdurend worden verbeterd.

2. Kan AI-spraakgeneratie meerdere talen nauwkeurig verwerken?

Ja, geavanceerde platforms ondersteunen meer dan 100 talen, met native uitspraak en regionale accenten. De kwaliteit verschilt per taal: de belangrijkste talen, zoals Engels, Spaans en Frans, krijgen de meeste aandacht bij de ontwikkeling en bieden de hoogste nauwkeurigheidspercentages.

3. Wat zijn de kosten van het genereren van spraak met behulp van AI?

De prijzen variëren van gratis abonnementen met beperkt gebruik tot zakelijke abonnementen die maandelijks tussen de $ 50 en $ 200 kosten. De meeste platforms rekenen per teken of per minuut gegenereerde audio, waarbij er voor gebruikers met grote volumes kortingen beschikbaar zijn. Voor commerciële licenties kunnen extra kosten in rekening worden gebracht.

4. Is het klonen van stemmen legaal voor zakelijk gebruik?

Het klonen van stemmen is legaal wanneer je de uitdrukkelijke toestemming van de eigenaar van de stem hebt of wanneer je je eigen stem kloont. Voor zakelijke toepassingen zijn duidelijke toestemmingsovereenkomsten en passend gebruiksbeleid vereist om juridische complicaties en ethische kwesties te voorkomen.

5. Hoe verhoudt AI-stemgeneratie zich tot menselijke stemacteurs?

Geautomatiseerde spraaksynthese biedt aanzienlijke voordelen op het gebied van kosten en snelheid, terwijl voor de meeste soorten content een kwaliteit wordt bereikt die bijna menselijk is. Menselijke stemacteurs blinken nog steeds uit in zeer emotionele content, creatieve interpretatie en genuanceerde vertolkingen, maar het verschil wordt steeds kleiner.

6. Kunnen AI-stemmen worden aangepast aan specifieke merkeisen?

Ja, veel platforms bieden mogelijkheden om de stem aan te passen, zoals de toon, het tempo, de klemtoonpatronen en de emotionele kenmerken. Met geavanceerde systemen kunnen stemmen worden getraind die aansluiten bij specifieke merkpersoonlijkheden en communicatiestijlen.

7. Welke technische vereisten zijn er nodig voor de integratie van AI-spraak?

De meeste platforms bieden REST-API’s aan waarvoor basiskennis van programmeren nodig is om ze te kunnen integreren. Voor cloudoplossingen is een betrouwbare internetverbinding vereist, terwijl on-premises-oplossingen aanzienlijke rekenkracht vereisen voor realtime verwerking.

8. Hoe gaat AI-stemgeneratie om met de uitspraak van technische termen?

Geavanceerde platforms beschikken over uitspraakwoordenboeken en bieden de mogelijkheid om technische termen met een aangepaste fonetische spelling weer te geven. Voor gespecialiseerd jargon en eigennamen kan het echter nodig zijn om de uitspraak handmatig aan te geven, om zo de nauwkeurigheid en consistentie te waarborgen.

Tekst-naar-spraaktechnologie is een baanbrekende innovatie die de manier waarop bedrijven audiocontent creëren en verspreiden ingrijpend verandert. In 2026 is de technologie zo ver ontwikkeld dat ze resultaten van professionele kwaliteit levert en tegelijkertijd ongekende schaalbaarheid en kostenefficiëntie biedt. Organisaties die geautomatiseerde spraaksynthese implementeren, kunnen aanzienlijke concurrentievoordelen behalen door snellere contentproductie, bredere taalondersteuning en verbeterde toegankelijkheidsfuncties. De sleutel tot een succesvolle implementatie ligt in het begrijpen van zowel de mogelijkheden als de beperkingen van de huidige technologie. Hoewel spraaksynthese in veel toepassingen uitblinkt, vereist het een doordachte integratieplanning, contentoptimalisatie en kwaliteitsborgingsprocessen om optimale resultaten te behalen. Bedrijven die investeren in een goede evaluatie, het testen en de ontwikkeling van workflows zullen het volledige potentieel van deze krachtige technologie realiseren.

Voor organisaties die wereldwijd uitbreiden of de toegankelijkheid van hun content willen verbeteren, bieden tekst-naar-spraakoplossingen een efficiënte manier om vooruitgang te boeken. De voortdurende ontwikkeling van deze technologie belooft nog meer mogelijkheden, waardoor het een onmisbaar hulpmiddel is geworden voor een moderne contentstrategie. Succes hangt af van de keuze voor het juiste platform, een goede optimalisatie van de content en het handhaven van kwaliteitsnormen die aansluiten bij de verwachtingen van het publiek.

Over de auteur

Geschreven door de experts op het gebied van SaaS- en AI-gestuurde lokalisatie en vertaling bij Trame. Ons team beschikt over jarenlange praktijkervaring in het ondersteunen van bedrijven met SaaS- en AI-gestuurde lokalisatie en vertaling, en biedt praktische adviezen die zijn gebaseerd op concrete resultaten.